Deepfakes : les deux faces du Yin et du Yang

Avec une croissance de 900% entre 2019 et 2020, les vidéos deepfakes en ligne tendent à dépasser le simple phénomène de mode pour s’ancrer dans les usages. Pour le meilleur... et pour le pire ?

Deepfakes : késako ?

Avez-vous vu la vidéo de Noël de la reine d'Angleterre plaisantant sur Harry et Meghan dans un discours empreint d’humour britannique ? Ou peut-être avez-vous aperçu cette séquence YouTube où Barack Obama traite Donald Trump de "parfait abruti" ? Et quid de la vidéo de Mark Zuckerberg prononçant un dérangeant discours sur l’omnipotence de Facebook ou encore de ce clip TikTok de Tom Cruise jouant au golf ? Si vous avez répondu oui à l'une de ces questions, alors vous avez fait l'expérience des deepfakes, des vidéos manipulées via le machine learning pour usurper l'identité de personnes réelles ou fabriquées de toutes pièces.

Pour mieux comprendre cette technologie, je vous propose un flashback en 2014 avec l’arrivée des Generative Adversarial Networks (GANs) qui permettent de créer des imitations parfaites d’images ou autres données. En substance, les GANs mettent en concurrence directe deux réseaux neuronaux appelés le générateur et le discriminateur. Pour faire simple, il s'agit de deux algorithmes qui vont s'entraîner mutuellement ; le premier va créer des nouvelles instances d’un objet, le deuxième va déterminer l’authenticité de l’objet. C’est le jeu du chat et de la souris, chaque partie se nourrissant non stop des méthodes de l’autre pour gagner en intelligence et en finesse. C’est ce qu’on appelle la retropropagation.

Concrètement, les GANs peuvent avoir de nombreuses applications et constituent la technologie sous-jacente aux deepfakes dont le terme a officiellement fait son apparition en 2017 sur la plateforme communautaire Reddit. Et s’il tient son nom d'un utilisateur ayant numériquement swapé les visages de célébrités telles que Gal Gadot et Scarlett Johansson sur les corps d'actrices de films X, le procédé s’est, depuis, popularisé bien au-delà de la sphère pornographique.

Deepfakes, Real life

Allez sur Google et tapez "deepfakes". Vous trouverez une quantité stupéfiante d'articles décriant les ravages créés par ces derniers. Manipulation politique, revenge porn, atteinte à la réputation des personnes ou des institutions… Bien que le procédé contribue à alimenter une crise de confiance généralisée (j’aborderai ce point dans ma troisième section), la technologie en elle-même n'est pas si mauvaise. Selon Sven Charleer, chercheur en UX et en Dataviz, les deepfakes méritent davantage une appréciation qu’une crucifixion. "Bien sûr, mettre des visages de célébrités sur vos stars du porno préférées est un cas d'utilisation intéressant, mais nous pouvons en tirer parti pour d'autres choses, comme insérer vos amis et votre famille dans des films et des émissions à succès !" explique t-il.

Et en effet, les applications du genre se sont multipliées ces deux dernières années, avec une approche récréative souvent qualifiée de "cheepfake" : malgré un caractère réaliste, la supercherie reste facilement détectable. Quelques exemples :

Reface, financée par le fonds US a16z, est l'exemple le plus emblématique de ce mouvement. Téléchargée plus de 100 millions de fois, elle s'est hissée au sommet des meilleures applications ludiques sur l'App Store et sur Google Play en 2020. Reface permet de morpher votre visage puis de le swapper avec des célébrités afin de l’incruster dans des clips et autres séquences cultes de la télévision ou du cinéma.

Wombo. Avec trois millions de téléchargements sur l'App Store en mars 2021, Wombo permet de synchroniser le mouvement de vos lèvres et, ainsi, de faire chanter n'importe qui à partir d'une simple photo.

Deep Nostalgia de MyHeritage peut, quant à lui, insuffler la vie à partir de n’importe quelle photo. Vous pouvez par exemple l'utiliser pour animer des personnages historiques ou un membre disparu de votre famille. Cool mais un peu creepy, je vous l’accorde.

Avatarify permet de créer des avatars en échangeant votre visage avec une célébrité, le tout doté d’une fonctionnalité gestuelle. Vous pouvez même l'utiliser dans des appels vidéo en direct sur Zoom ou Skype. C'est tout de même mieux que de louer une chèvre pour animer son call, n'est-ce pas ?

Zoomer, de son côté, entend proposer aux étudiants de générer leur propre deepfake afin de les remplacer lors des cours en ligne. No comment.

Notez cependant que les deepfakes ne se cantonnent pas aux apps. L'industrie cinématographique fait ainsi régulièrement appel au procédé pour la réalisation de certaines scènes, économisant ainsi les coûts liés au recrutement d’une doublure, à l’instar du Grand Moff Tarkin dans “Rogue One: A Star Wars Story” sorti en 2016. Les deepfakes infusent également d’autres secteurs du divertissement. Faites l’expérience de Zizi, un cabaret de drag queens extrêmement bien exécuté (vraiment, regardez, cela vaut le détour), ou de Take This Lollilop, un film d'horreur interactif déjà visionné par 100 millions de personnes via webcam et 300 millions de plus via TikTok et YouTube.

Un business à part entière

Les deepfakes sont généralement considérés comme une branche des médias dits “synthétiques”, c’est à dire générés ou modifiés par l'IA. Un marché relativement vaste qu’a cartographié Samsung Next Ventures dans un livre blanc à lire absolument par toute personne intéressée par le sujet.

Selon ce rapport, les médias synthétiques annonceraient le début d’une nouvelle ère dans l’évolution des médias. Alors que la presse écrite, la radio et la télévision ont permis une distribution de masse de l’information, internet en a facilité la démocratisation. Les médias synthétiques donneraient désormais une nouvelle impulsion à l’appropriation et à la créativité des contenus.

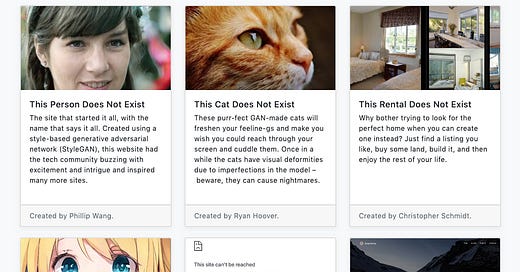

À bien y réfléchir, cette perspective va de pair avec le développement de l'économie des créateurs. De là à imaginer des jumeaux numériques pour les célébrités, les influenceurs ou encore les experts ? Moins de fatigue, des niveaux de créativité illimités grâce au machine learning et à l’IA, plus de missions, plus de revenus… Et pourquoi pas ? Dans un futur D2A (Direct-To-Avatar), les médias synthétiques permettront la création de toutes sortes de créatures virtuelles. Comme l'explique l’étude Samsung Next, "certains ressembleront à des personnages de bandes dessinées, d'autres ressembleront et agiront comme de vrais humains, d'autres encore ne seront même pas incarnés". La société Generated Media, par exemple, propose Anonymizer, un outil qui, à partir d’une photo, génère de faux visages avec quelques airs de ressemblance. En somme, un petit quelque chose de vous mais pas tout à fait, histoire de protéger votre identité sur le web.

Les avatars transforment également le monde du retail en permettant aux clients de se voir virtuellement dans des vêtements promus sur les médias sociaux et les sites marchands (j’ai d’ailleurs récemment écrit sur le sujet), avec, à la clé, une expérience d’achat en ligne totalement personnalisée.

Mais il existe encore d'autres applications dont voici quelques exemples concrets :

Marketing - J'ai récemment discuté avec Alex Robinson, le fondateur de Vidon, un service qui vous aide à créer un deepfake qui vous ressemble et parle comme vous. Il vous permet de réaliser, à l’échelle, des vidéos de prospection personnalisées par l'IA. Comme Robinson me l'a expliqué : "Les entreprises personnalisent les textes des e-mails depuis des décennies mais, désormais, la technologie deepfake permet d’apporter une personnalisation poussée aux vidéos pour créer une expérience intime avec le client."

Culture - En 2018, le Musée et Centre éducatif de l'Holocauste de l'Illinois a créé des entretiens hologrammatiques. Cela a permis aux visiteurs de parler et d'interagir avec des survivants de cette sombre période, ramenant l'histoire à la vie.

Edtech - Dans la même veine, les deepfakes peuvent apporter une nouvelle dimension à tout apprentissage. Récemment, la société britannique Edtech Guide Education a levé 6 millions de livres sterling pour ce qu'elle appelle son "Netflix de la formation des enseignants". Selon les mots de son PDG, Leon Hady : "Notre application de la technologie deepfake signifie que les élèves peuvent avoir Stephen Hawking enseignant la physique, ou Shakespeare expliquant son écriture - ce sera aussi révolutionnaire pour l'éducation que l'était le premier tableau noir."

Santé - Le projet Revoice de l'association ALS permet aux patients ayant perdu la capacité de parler de continuer à utiliser leur voix. Comment ? En utilisant des deepfakes afin de créer des pistes vocales synthétiques personnalisées qui peuvent être jouées à la demande avec une console sonore.

Fascinant, non ? N'oubliez pas, cependant, que les entreprises actives dans ce domaine ont un énorme défi à relever : elles doivent s'engager à respecter des normes éthiques élevées. Une condition sine qua non afin de s'assurer que leur technologie ne sera pas détournée à des fins nuisibles. Une véritable gageure.

L’érosion de la confiance

La contrefaçon et les diverses formes de manipulation existent depuis longtemps. Bien avant l’entrée en scène des deepfakes, les logiciels de retouche d’images avaient déjà soulevé nombre de questions sur le sujet de l’authenticité. Certains experts décrivent d’ailleurs la technologie deepfake comme un "Photoshop sous stéroïdes", soulignant par là la puissance de son impact.

Car si de multiples initiatives ont été prises pour s'attaquer au problème, aucune d'entre elles ne semble, pour l’heure, efficace à 100%. D'autant plus que la technologie s'améliore chaque jour un peu plus, rendant obsolètes toutes les techniques artisanales utilisées pour repérer un deepfake, comme observer le clignement des yeux ou l’un des 15 autres signes énumérés dans cet article. Parmi les outils à surveiller, on notera :

Les signatures numériques ou watermarks - Destinés à tracer l’originalité de contenus vidéos ou photos, ces outils sont à considérer comme un sceau d'authenticité. Truepic, par exemple, travaille avec Qualcom pour intégrer cette sécurité matérielle à votre futur téléphone. Mais s’il permet de certifier qu'une vidéo n'a pas été manipulée ou fabriquée, ce procédé ne résout pas tous les problèmes. Car parfois, le souci ne relève pas de l'authenticité du clip en tant que tel, mais de l'authenticité de la narration. Gare au contexte ! En outre, le piratage informatique pourrait permettre d’introduire du faux contenu dans le circuit électronique de la caméra de l'appareil-hôte, faisant passer un contenu falsifié pour authentique.

La détection de deepfakes - Le but est ici d'ajouter un "filtre de confiance" permettant d'analyser une vidéo suspecte afin de déterminer, sur la base d’un score, si celle-ci a été manipulée. Parmi les start-ups opérant dans ce domaine, citons Sensity, Sentinel, Kroop, DuckDuckGoose, Deepware ou Defudger.

Les grands acteurs s'emparent également de cette problématique, à l’image de Microsoft qui a lancé sa propre solution Video Authenticator. Un bon début, même si la précision de ces outils reste encore à optimiser. Selon le Dr Jyoti Joshi, cofondateur de Kroop AI : "L'un des défis (...) est de créer un détecteur universel. Comme on l'a vu précédemment avec les systèmes d'analyse des visages, le déséquilibre entre l'ethnicité et le sexe peut amener les systèmes à mal classer certaines données sous-représentées. Les enjeux sont encore plus élevés lorsqu'il s'agit de la détection des deepfakes". Car pour combattre les deepfakes, ces outils doivent fonctionner… comme des deepfakes, c’est à dire en puisant dans une base d’entraînement regulièrement mise à jour. Autrement dit, un véritable jeu du chat et de la souris se joue entre concepteurs et détecteurs de deepfakes à une échelle de temps très courte.

L'avenir apportera certainement de nouvelles options. En complément de sa solution maison SimSearchNet++, Facebook s'est par exemple associé à d'autres leaders du secteur et à des experts universitaires afin de créer le Deepfake Detection Challenge (DFTC) dans le but d'accélérer le développement de nouvelles méthodes de détection.

Intrinsèquement liée au sujet, la question de la réglementation reste également un point crucial qui soulève bien des débats…

Bref, un écosystème complexe qui nourrit en son sein le "Liar’s Dividend” ou, en français, le dividende du menteur. "Pour la génération à venir, la plus grande menace sur la confiance n'est pas d'être trompé par des deepfakes ; le danger est de considérer presque toutes les informations comme indignes de confiance" souligne Rachel Botsman, experte et auteur, dans un article pour Wired. Un état d'esprit qu'Aviv Avadya, chercheur en médias et fondateur du Thoughtful Technology Project, nomme "l'apathie à l'égard de la réalité".

Crise de confiance généralisée et dysmorphie de l’information : à l’heure où l’IRL, bascule de plus en plus dans un irréel fait de technologies virtuelles et immersives, n’est-il pas déjà trop tard ?

Marie

PS - J’ai traité le sujet des deepfakes en avant-première il y a quelques semaines dans Magma, le média qui déniche les dernières tendances et opportunités business. J’y écris de temps en temps ;) Vous pouvez, grâce à ce lien de parrainage, tester gratuitement ce support pendant 15 jours et bénéficier de 50€ de remise sur votre abonnement (et moi aussi. )

Un neuroscientifique et un physicien ont utilisé l'IA pour recréer une peinture perdue, enfouie sous une toile de Picasso (et l'ont vendue en tant que NFT).

Allergique à Zoom et grande adepte de la marche à pied, je ne cache pas le fait que cette start-up m'enthousiasme particulièrement.

Intriguée par “Be real”, ce réseau social français qui mise sur l’authenticité et le #nofilter.

Pour occuper les longues soirées de couvre-feu, je vous recommande “Les Philosophes sur Twitch jouant à Flight Simulator” (cela ne s’invente pas !)

"Responsable de la compassion et de la pleine conscience” : un nouveau poste stratégique en entreprise ? Ne roulez pas des yeux, cela existe déjà chez Linkedin. En même temps, est-ce vraiment surprenant ? Force est de reconnaître que L’univers Alternatif de Linkedin, c’est quelque chose !

Depths of Wikipedia est un compte Instagram présentant des captures d'écran de fiches Wikipédia inhabituelles et fascinantes.

A propos de Walking desks, je te recommande ceux-là, d'une startup française. J'en utilise un depuis des années 😉 https://www.activup.net/